Uanset om du har ansvar inden for softwareudvikling, devops, systemer, skyer, testautomatisering, pålidelighed på stedet, førende scrum-teams, infosec eller andre områder inden for informationsteknologi, har du stigende muligheder og krav til at arbejde med data, analyse og maskinindlæring .

Tech Spotlight: Analytics

- Sådan vælger du en dataanalyseplatform ()

- 6 bedste fremgangsmåder til visualisering af forretningsdata (Computerworld)

- Healthcare analytics: 4 succeshistorier (CIO)

- SD-WAN og analyse: Et ægteskab skabt til den nye normale (Network World)

- Sådan beskyttes algoritmer som intellektuel ejendomsret (CSO)

Din eksponering for analytics kan komme gennem it-data, såsom at udvikle metrics og indsigt fra agile, devops eller website-metrics. Der er ingen bedre måde at lære de grundlæggende færdigheder og værktøjer omkring data, analyser og maskinindlæring end at anvende dem på data, som du kender, og som du kan bruge til indsigt til at drive handlinger.

Ting bliver lidt mere komplekse, når du først forgrener dig fra en verden af it-data og leverer tjenester til datavidenskabsteams, borgerdataforskere og andre forretningsanalytikere, der udfører datavisualiseringer, analyser og maskinindlæring.

Først skal data indlæses og renses. Afhængigt af datavolumen, variation og hastighed vil du sandsynligvis støde på flere back-end-databaser og cloud-datateknologier. Endelig har det, der plejede at være et valg mellem forretningsinformation og datavisualiseringsværktøjer, i løbet af de sidste mange år rullet ind i en kompleks matrix af analyser af fuld livscyklus og platforme til maskinindlæring.

Vigtigheden af analyse og maskinindlæring øger it's ansvar inden for flere områder. For eksempel:

- IT leverer ofte tjenester omkring alle dataintegrationer, back-end-databaser og analytiske platforme.

- Devops-teams distribuerer og skalerer ofte datainfrastrukturen for at muliggøre eksperimentering med machine learning-modeller og understøtter derefter produktionsdatabehandling.

- Netværksdriftsteam opretter sikre forbindelser mellem SaaS-analyseværktøjer, multiclouds og datacentre.

- IT-servicestyringsteams reagerer på data- og analysetjenesteanmodninger og hændelser.

- Infosec fører tilsyn med datasikkerhedsstyring og implementeringer.

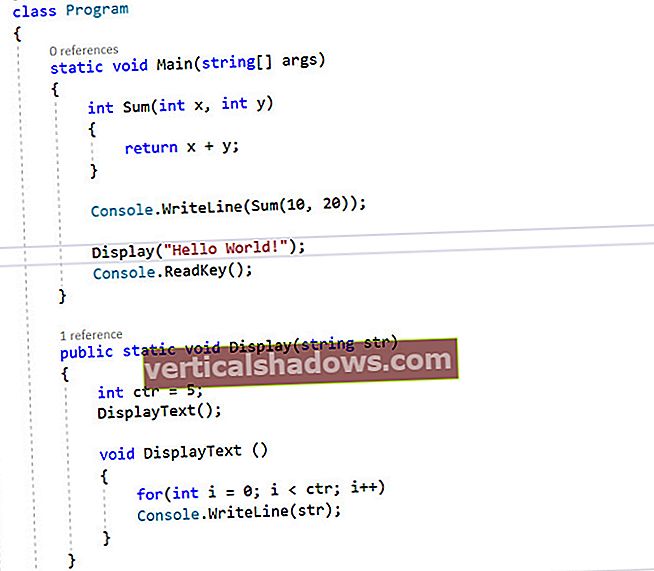

- Udviklere integrerer analyse- og maskinlæringsmodeller i applikationer.

I betragtning af eksplosionen af analytics, cloud-dataplatforme og machine learning-kapaciteter er her en primer til bedre at forstå analytics-livscyklussen fra dataintegration og rengøring til dataops og modelops til databaser, dataplatforme og selve analysetilbud.

Analytics begynder med dataintegration og datarensning

Inden analytikere, borgerdata-videnskabsmænd eller datavidenskabsteams kan udføre analyser, skal de krævede datakilder være tilgængelige for dem i deres datavisualiserings- og analyseplatforme.

For at starte kan der være forretningskrav til at integrere data fra flere virksomhedssystemer, udtrække data fra SaaS-applikationer eller streame data fra IoT-sensorer og andre realtids datakilder.

Dette er alle trin til at indsamle, indlæse og integrere data til analyse og maskinindlæring. Afhængig af kompleksiteten af data- og datakvalitetsproblemerne er der muligheder for at blive involveret i dataops, datakatalogisering, masterdatastyring og andre datastyringsinitiativer.

Vi kender alle sætningen "skrald ind, skrald ud." Analytikere skal være bekymrede over kvaliteten af deres data, og dataforskere skal være bekymrede over bias i deres maskinindlæringsmodeller. Også rettidigheden ved at integrere nye data er afgørende for virksomheder, der ønsker at blive mere datadrevne i realtid. Af disse grunde er rørledningerne, der indlæser og behandler data, kritisk vigtige i analyse og maskinindlæring.

Databaser og dataplatforme til alle typer datahåndteringsudfordringer

Indlæsning og behandling af data er et nødvendigt første skridt, men så bliver tingene mere komplicerede, når man vælger optimale databaser. Dagens valg inkluderer virksomhedsdatalagre, datasøer, store databehandlingsplatforme og specialiserede NoSQL-, graf-, nøgleværdi-, dokument- og søjledatabaser. For at understøtte datalager og analyse i stor skala er der platforme som Snowflake, Redshift, BigQuery, Vertica og Greenplum. Endelig er der de store dataplatforme, inklusive Spark og Hadoop.

Store virksomheder har sandsynligvis flere datalagre og bruger cloud-dataplatforme som Cloudera Data Platform eller MapR Data Platform eller data-orkestreringsplatforme som InfoWorks DataFoundy for at gøre alle disse repositorier tilgængelige til analyse.

De store offentlige skyer, inklusive AWS, GCP og Azure, har alle datastyringsplatforme og -tjenester, der skal sigtes igennem. For eksempel er Azure Synapse Analytics Microsofts SQL-datalager i skyen, mens Azure Cosmos DB giver grænseflader til mange NoSQL-datalagre, herunder Cassandra (søjledata), MongoDB (nøgleværdi og dokumentdata) og Gremlin (grafdata) .

Datasøer er populære indlæsningsdokke til centralisering af ustrukturerede data til hurtig analyse, og man kan vælge fra Azure Data Lake, Amazon S3 eller Google Cloud Storage for at tjene dette formål. Til behandling af store data har AWS-, GCP- og Azure-skyerne alle også Spark- og Hadoop-tilbud.

Analytics-platforme målretter maskinindlæring og samarbejde

Med data indlæst, renset og lagret kan dataforskere og analytikere begynde at udføre analyser og maskinindlæring. Organisationer har mange muligheder afhængigt af analysetyperne, analytikerteamets færdigheder, der udfører arbejdet, og strukturen af de underliggende data.

Analytics kan udføres i selvbetjeningsdatavisualiseringsværktøjer som Tableau og Microsoft Power BI. Begge disse værktøjer målretter borgerens dataforskere og udsætter visualiseringer, beregninger og grundlæggende analyser. Disse værktøjer understøtter grundlæggende dataintegration og datastrukturering, men mere kompleks dataknægtning sker ofte inden analysetrinene. Tableau Data Prep og Azure Data Factory er de ledsagende værktøjer, der hjælper med at integrere og transformere data.

Analytics-teams, der ønsker at automatisere mere end bare dataintegration og prep, kan se på platforme som Alteryx Analytics Process Automation. Denne end-to-end, samarbejdsplatform forbinder udviklere, analytikere, borgerdata-videnskabsmænd og dataforskere med automatisering af workflow og selvbetjening, databehandling, analyse og maskinindlæring.

Alan Jacobson, chief analytics and data officer hos Alteryx, forklarer: ”Fremkomsten af analytisk procesautomatisering (APA) som en kategori understreger en ny forventning for enhver arbejdstager i en organisation om at være en dataarbejder. IT-udviklere er ingen undtagelse, og udvidelsen af Alteryx APA-platformen er især nyttig for disse vidensarbejdere. ”

Der er flere værktøjer og platforme, der er målrettet mod dataforskere, der har til formål at gøre dem mere produktive med teknologier som Python og R, mens de forenkler mange af de operationelle og infrastrukturelle trin. For eksempel er Databricks en datalogisk operationel platform, der muliggør implementering af algoritmer til Apache Spark og TensorFlow, mens selvadministration af computerklynger på AWS eller Azure skyen.

Nu kombinerer nogle platforme som SAS Viya dataforberedelse, analyse, prognoser, maskinindlæring, tekstanalyse og maskinindlæringsmodelstyring i en enkelt modelops-platform. SAS opererer analyser og målretter dataforskere, forretningsanalytikere, udviklere og ledere med en end-to-end samarbejdsplatform.

David Duling, direktør for beslutningsstyringsforskning og -udvikling hos SAS, siger: ”Vi ser modelops som praksis med at skabe en gentagelig, auditabel pipeline af operationer til implementering af alle analyser, inklusive AI- og ML-modeller, i operationelle systemer. Som en del af modelops kan vi bruge moderne devops-metoder til kodeadministration, test og overvågning. Dette hjælper med at forbedre hyppigheden og pålideligheden af modelimplementering, hvilket igen forbedrer smidigheden i forretningsprocesser, der er bygget på disse modeller. ”

Dataiku er en anden platform, der stræber efter at bringe dataklargøring, analyse og maskinindlæring til voksende datavidenskabsteams og deres samarbejdspartnere. Dataiku har en visuel programmeringsmodel, der muliggør samarbejde og kode notesbøger til mere avancerede SQL- og Python-udviklere.

Andre analyse- og maskinlæringsplatforme fra førende softwareleverandører til formål er at bringe analysefunktioner til datacenter og skydatakilder. For eksempel sigter Oracle Analytics Cloud og SAP Analytics Cloud begge mod at centralisere intelligens og automatisere indsigt for at muliggøre end-to-end-beslutninger.

Valg af en dataanalyseplatform

Valg af dataintegrations-, lager- og analyseværktøjer plejede at være mere ligetil før stigningen af big data, machine learning og datastyring. I dag er der en blanding af terminologi, platformskapacitet, operationelle krav, styringsbehov og målrettede brugerpersoner, der gør valg af platforme mere komplekse, især da mange leverandører understøtter flere anvendelsesparadigmer.

Virksomheder adskiller sig i analytiske krav og behov, men bør søge nye platforme fra udsigtspunktet af det, der allerede er på plads. For eksempel:

- Virksomheder, der har haft succes med borgerdatavidenskabsprogrammer, og som allerede har datavisualiseringsværktøjer på plads, vil muligvis udvide dette program med analyseprocesautomatisering eller dataklargøringsteknologier.

- Virksomheder, der ønsker en værktøjskæde, der gør det muligt for dataforskere, der arbejder i forskellige dele af virksomheden, kan overveje end-to-end-analyseplatforme med modelops-muligheder.

- Organisationer med flere, forskellige back-end-dataplatforme kan drage fordel af cloud-dataplatforme til at katalogisere og administrere dem centralt.

- Virksomheder, der standardiserer alle eller de fleste datafunktioner på en enkelt offentlig cloud-leverandør, bør undersøge de dataintegrations-, datahåndterings- og dataanalyseplatforme, der tilbydes.

Da analytics og machine learning bliver en vigtig kernekompetence, bør teknologer overveje at uddybe deres forståelse af de tilgængelige platforme og deres evner. Kraften og værdien af analyseplatforme vil kun stige, ligesom deres indflydelse i hele virksomheden.